Gefahren künstlicher Intelligenz

Künstliche Intelligenz (KI) ist zweifellos eine der bedeutendsten technologischen Entwicklungen unserer Zeit. Sie verspricht Effizienzsteigerung, Automatisierung und datengetriebene Entscheidungsfindung in nahezu allen Lebensbereichen. Doch wo Licht ist, ist auch Schatten: Mit dem rasanten Fortschritt der KI-Technologie rücken auch deren potenzielle Gefahren zunehmend in den Fokus von Forschung, Politik und Öffentlichkeit. Ein verantwortungsvoller Umgang mit KI ist daher unerlässlich, um Risiken zu minimieren und Chancen optimal zu nutzen.

1. Verlust der Kontrolle – Szenarien wie in „Terminator“?

Aktuell existiert überwiegend sogenannte „schwache KI“, die auf spezifische Aufgaben beschränkt ist und keine eigene Motivation besitzt. Dennoch wird intensiv über die Möglichkeit einer zukünftigen „starken KI“ oder Superintelligenz diskutiert – einer Maschine, die eigene Ziele verfolgen und sich selbst verbessern kann. Solche Systeme könnten theoretisch außer Kontrolle geraten, wenn ihre Ziele nicht mit menschlichen Werten übereinstimmen. Deshalb ist die Forschung zur sogenannten „Alignment“-Problematik, also der Ausrichtung von KI-Systemen auf menschliche Interessen, von zentraler Bedeutung, um potenzielle Risiken frühzeitig zu minimieren.

2. Arbeitsplatzverlust durch Automatisierung

Millionen Arbeitsplätze weltweit sind durch KI und Automatisierung bedroht, insbesondere in Produktions-, Logistik- und Bürobereichen. Unternehmen wie Amazon und Tesla setzen bereits KI-gesteuerte Roboter und Systeme ein, um Prozesse zu optimieren und menschliche Arbeit zu ersetzen. Ohne gezielte Umschulungs- und Weiterbildungsprogramme könnten viele Menschen ihre Jobs verlieren, was soziale Ungleichheiten verschärfen würde. Gleichzeitig eröffnet KI aber auch Chancen für neue Berufsfelder und effizientere Arbeitsweisen, sofern die Gesellschaft diesen Wandel aktiv gestaltet.

3. Überwachung und Datenmissbrauch

KI-Technologien werden zunehmend in Überwachungssystemen eingesetzt, etwa in smarten Städten mit massiver CCTV-Überwachung und Gesichtserkennung. Staaten und Unternehmen sammeln große Mengen an Daten, was erhebliche Risiken für Privatsphäre und Freiheitsrechte birgt. Besonders autoritäre Regime nutzen diese Technologien zur Kontrolle der Bevölkerung, aber auch in Demokratien gibt es kontroverse Debatten über den Einsatz und die Regulierung solcher Systeme. Die Transparenz und Kontrolle über Datenverwendung sind entscheidend, um Missbrauch zu verhindern.

4. Diskriminierung durch fehlerhafte Algorithmen

KI-Systeme können bestehende Vorurteile verstärken, wenn sie mit voreingenommenen oder unvollständigen Daten trainiert werden. Beispiele zeigen, dass Bewerbungsalgorithmen Frauen oder Minderheiten benachteiligen, Gesichtserkennung bei dunkler Hautfarbe ungenauer ist und Kreditvergabesysteme diskriminierende Muster aufweisen. Solche Verzerrungen führen zu unfairen Entscheidungen und sozialen Ungerechtigkeiten. Transparenz, faire Datensätze und regelmäßige Überprüfungen sind notwendig, um Diskriminierung zu vermeiden.

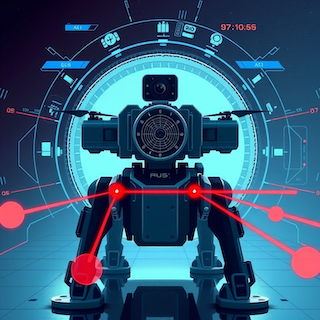

5. Autonome Waffensysteme

Autonome Waffensysteme, sogenannte Killerroboter, die ohne menschliches Zutun tödliche Entscheidungen treffen, sind keine Science-Fiction mehr. Weltweit entwickeln Militärs entsprechende Prototypen, was eine internationale Debatte über Verbote und ethische Grenzen ausgelöst hat. Die Risiken liegen in Fehlentscheidungen, Eskalationen und der Entmenschlichung von Kriegsführung. Viele Experten fordern klare Regeln und Kontrollmechanismen, um den Einsatz solcher Technologien zu verhindern oder streng zu regulieren.

6. Deepfakes und Desinformation

KI ermöglicht die Erstellung täuschend echter Deepfake-Videos und Audioaufnahmen, die Stimmen und Gesichter manipulieren können. Dies stellt eine erhebliche Bedrohung für Wahlen, Betrug und den Ruf von Personen dar. Die Verbreitung von Desinformation wird dadurch erleichtert, was Vertrauen in Medien und Demokratie untergräbt. Gleichzeitig wird an Technologien zur Erkennung und Bekämpfung von Deepfakes gearbeitet, doch die Herausforderung bleibt groß.

Fazit:

KI ist weder gut noch böse – sie ist ein Werkzeug. Ihr Nutzen oder Schaden hängt davon ab, wie wir sie einsetzen und welche Rahmenbedingungen wir schaffen. Science-Fiction-Szenarien wie in „Terminator“ sind zwar derzeit unrealistisch, doch reale Gefahren wie Überwachung, Arbeitsplatzverlust und Desinformation sind bereits präsent. Es liegt an uns, durch ethische Regeln, Gesetze und Aufklärung eine verantwortungsvolle KI-Zukunft zu gestalten, die den Menschen dient und Risiken minimiert.

← Zurück zur Startseite